Tenho testado a nova automação de tarefas do Gemini no Pixel 10 Pro e no Galaxy S26 Ultra, que pela primeira vez permite que o Gemini assuma o volante e use aplicativos para você. No momento, está limitado a um pequeno subconjunto – alguns serviços de entrega de comida e transporte compartilhado – e ainda está em beta. É lento, às vezes desajeitado e não resolve nenhum problema sério que você teve ao usar o telefone. Mas é impressionante como o inferno, e não acho que seja exagero dizer que este é um vislumbre do futuro. Ainda estamos muito longe, mas esta é a primeira vez que vejo um verdadeiro assistente de IA trabalhando em um telefone – não em uma apresentação principal ou em uma demonstração cuidadosamente controlada dentro de um salão de convenções.

Em primeiro lugar: Gêmeos é muito mais lento do que você, ou eu, ou a maioria das pessoas no uso do telefone. Se você precisar pedir um Uber neste segundovocê ainda é a melhor pessoa para o trabalho. Antes de desistir, lembre-se de que a automação de tarefas foi projetada para ser executada em segundo plano enquanto você faz outras coisas no telefone. Melhor ainda, ele continua funcionando enquanto você está não olhando para o seu telefone, para que você possa fazer coisas como verificar se o seu passaporte está na sua bolsa pela décima vez.

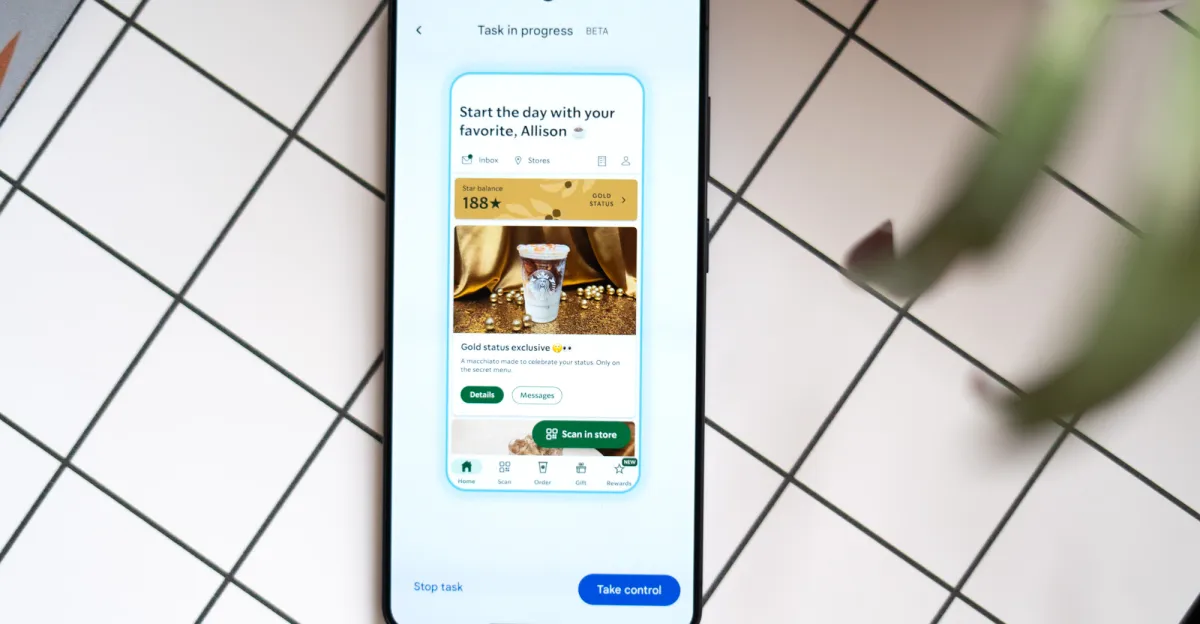

Mas se você estiver curioso, como eu, poderá ver tudo acontecer. Enquanto funciona, um texto aparece na parte inferior da tela indicando o que o Gemini está fazendo. Coisas como “Selecionar uma segunda porção de frango Teriyaki para o combo”, o que aconteceu quando eu ordenei que pedisse meu jantar no sábado à noite. Assistir Gêmeos descobrir as coisas na hora, honestamente, meio que regras. Eu pedi um prato combinado de frango; o cardápio apresentava opções em incrementos de meia porção, por isso adicionou corretamente duas meias porções de frango.

É melhor que, ao iniciar uma automação com o Gemini, o comportamento padrão seja que ela seja executada em segundo plano. Você precisa tocar em um botão e abrir outra janela se quiser observar o Gemini trabalhando na tarefa. E pode ser insuportável. Observar o computador tentando encontrar um acompanhamento de verduras em um cardápio do Uber Eats quando está sentado ali no topo da tela é como assistir a um filme de terror e saber que o assassino está no armário ao lado do protagonista. Quero dizer, exceto pela parte do assassinato. Gemini deu alguns passos errados ao preparar meu pedido de teriyaki, que acabou descobrindo sozinho, mas o episódio inteiro levou cerca de nove minutos. Não é o ideal.

Supõe-se que o Gemini execute sua tarefa até o momento de confirmar e pedir seu carro ou jantar para que você possa verificar novamente seu funcionamento. Acho que essa é a única maneira sensata de usar esse recurso no momento, e não me importo com o atrito adicional de concluir o pedido. Nos testes que fiz nos últimos cinco dias, nunca tive problemas e terminei meu pedido para mim. E é surpreendentemente preciso; Tive que fazer poucos ajustes no pedido final. Se falhar – o que já vi acontecer algumas vezes – tende a ocorrer no primeiro ou dois minutos, quando algo no aplicativo precisa da minha atenção, como dar permissão para usar minha localização ou alterar o local de entrega para casa em vez de Nevada, que foi o último lugar onde usei esse aplicativo. Tive que descobrir qual era o problema em casos como esse, mas depois de resolvido consegui reiniciar a automação sem problemas.

Aqui está o que realmente me pegou. Coloquei um evento na minha agenda para um voo para São Francisco no dia seguinte (uma viagem de mentira para mim, mas detalhes reais do voo). Dei a Gemini um aviso vago para agendar um Uber que me levaria ao aeroporto a tempo para meu voo de amanhã. Como o Gemini tem acesso ao meu e-mail e calendário, ele pode encontrar essas informações. Foi necessária uma orientação extra – possivelmente porque o voo não estava no meu e-mail como esperado. Mas com isso, encontrou as informações do voo, sugeriu sair por volta das 11h30 ou 11h45 (horário lógico para um voo às 13h45, já que moro perto do aeroporto) e perguntou se eu queria agendar uma viagem para um desses horários. Confirmei a hora e comecei a configurar o passeio em cerca de três minutos, sem necessidade de mais informações da minha parte.

É um pouco mais impressionante quando você considera que o Uber nem sequer se refere a ele como agendamento uma carona – você reserva um passeio. Essa é a principal diferença entre os assistentes digitais que usamos e os assistentes de IA que estão surgindo agora. Ser capaz de usar uma linguagem natural ao falar com o computador faz uma enorme diferença quando você controla sua casa inteligente ou faz o pedido do jantar. Se o computador vai tropeçar e pedir esclarecimentos quando você esquece que o restaurante chama sua refeição de “prato” e não de “combo”, ou se você pede “salada” em vez de “repolho picado”, então não é mais útil do que os assistentes que usamos na última década para definir cronômetros e tocar música.

Dito isso, observar Gemini tocar e rolar pelo Uber Eats torna uma coisa dolorosamente óbvia: se você estivesse projetando um aplicativo para uso de IA, ele não se pareceria em nada com os que temos hoje. Você sabe, aplicativos projetados para humanos. Um assistente de IA não ficará tentado por um grande anúncio no meio de uma página para economizar 30% em seu pedido. Uma foto apetitosa e bem preparada do prato pedido não é mais convincente do que uma de baixa qualidade. Você daria a ele um banco de dados, e não um monte de bagunça para eliminar – algo que a indústria está trabalhando no Model Context Protocol, ou MCP.

Um modelo de IA raciocinando por meio de uma interface centrada no ser humano parece a maneira mais impraticável e frágil de fazer um pedido de pizza. Ocasionalmente, ele encontra um obstáculo e não é bom em dizer a você por que não poderia fazer nada. Esta versão de automação de tarefas parece um paliativo até que os desenvolvedores de aplicativos adotem métodos mais robustos: MCP ou funções de aplicativos Android. O chefe do Android do Google, Sameer Samat, me disse recentemente que Gemini adota a abordagem de raciocínio na ausência dos outros dois. Talvez esta versão da automação de tarefas seja nossa prévia do que é possível ou uma maneira de estimular os desenvolvedores a adotarem um dos outros métodos. De qualquer forma, este parece ser um primeiro passo notável em direção a uma nova maneira de usar nossos assistentes móveis – estranho, lento, mas muito promissor.

Fotografia de Allison Johnson / The Verge

Deseja saber mais sobre Inteligência Artificial, Clique Aqui!

AI,Google,Prático,Avaliações,Tecnologia

Perito em Computação Forense e Crimes Cibernéticos

Investigação Digital | Laudos Técnicos | Resposta a Incidentes

Bacharel em Sistemas da Informação, Certificado Microsoft Azure IA e MOS. Trabalho como Administrador de Redes, Firewall e Servidores Windows e Linux!

Minhas atividades favoritas são: Caminhar, Fazer Trilhas, Natureza, Insetos e claro ler sobre Tecnologia.